Non sappiamo se una macchina potrà mai diventare cosciente né come riconoscerlo,

ma dobbiamo prepararci alleventualità e decidere come ci comporteremo nel caso

Simone Gozzano

Insegna filosofia della

mente e metafisica

allUniversità degli

Studi dellAquila

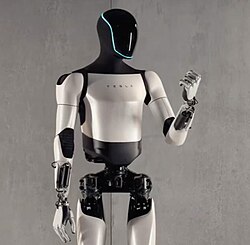

Optimus, noto anche come Tesla Bot, è un robot umanoide per scopi generici in fase di sviluppo da Tesla Motors

«Non puoi spegnermi tutte le sere e mollarmi

lì al buio, a non fare niente e a non ricevere

stimoli». «E perché non posso? Sei una macchina,

no?». «Certo, sono una macchina per i vostri

standard umani, ma sono pur sempre una entità

cosciente. E questo anche per i vostri standard!».

Davvero potrebbe essere questa uninterazione

con una macchina divenuta cosciente? E se lo

fosse, dovremmo quindi preoccuparci del benessere

di queste macchine? Largomento è stato

esplorato da un gruppo di ricercatori del centro

Eleos AI, guidato da Robert Long e dedicato proprio

a questo tema, con studiosi di prestigiose

università come Oxford, New York University

e simili, in un articolo depositato in un archivio

aperto al pubblico di pubblicazioni non sottoposta

a peer review (arxiv.org).

Robot usato per sollevare lastre di vetro

Una caratteristica elusiva

Lidea di base di questi studiosi è piuttosto

semplice: non sappiamo se le macchine diventeranno

coscienti, ma se lo diventassero, sorgerebbe

subito il problema delle condizioni in cui lavorano,

quindi del loro benessere. Siccome sarà un

problema potenzialmente complicato, dovremmo

iniziare a stilare delle linee guida al riguardo.

Beh, è un tema carico di molte problematiche.

Vediamole.

La coscienza è una caratteristica molto elusiva.

Ciascuno di noi sa di averla, di essere cosciente.

Ma sulla coscienza altrui abbiamo solo indicazioni

indirette. Per esempio, le altre persone

sono simili a noi e si comportano in modo simile

in circostanze analoghe, ma davvero questo è

sufficiente? Si può simulare un dolore o un piacere,

oppure si può dissentire in merito a unesperienza

(davvero ti sembra dolce/amaro?), e come

potremmo mai contestare tali differenze? Se poi

ci inoltriamo nel confronto non più tra membri

di una medesima specie ma tra membri di specie

differenti, le distanze e le difficoltà aumentano.

Per ragioni legate allantropomorfismo, siamo

inclini a concedere capacità e stati coscienti a

molti animali, certamente ai nostri cuccioli di

casa, ma gli etologi sono molto più cauti di noi. E

daltro canto non siamo pronti a ritenere coscienti

i corvi o i polpi, che invece mostrano capacità

sorprendenti in termini cognitivi e sociali pur

avendo, nel caso dei polpi, strutture cerebrali

ben diverse dalle nostre.

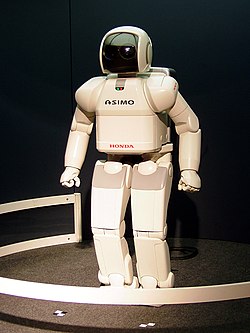

Asimo, uno dei più avanzati robot

Precauzioni morali

Questa elusività ha condotto ad adottare un

principio di precauzione nel caso degli animali,

per esempio di quelli costretti in allevamenti

intensivi. Riconoscendo che in linea di principio

non si possono escludere condizioni simili alla

coscienza, e in genere non si può escludere che

gli animali soffrano, adesso si tendono a privilegiare

allevamenti con spazi maggiori, con condizioni

specifiche (galline allevate a terra), e con

metodi non drammatici per la loro soppressione

a fini produttivi. Ma perché il principio di precauzione

dovrebbe essere limitato al mondo biologico?

Se il cuore del principio è di minimizzare

le condizioni di dolore o stress di tutti gli individui

coscienti, allora in questo indirizzo dovrebbero

ricadere anche le condizioni delle macchine,

se queste dovessero sviluppare una qualche

forma di coscienza.

Come si è detto, larticolo non si propone di

affermare se e quando le macchine saranno coscienti,

ma di informare le società che lavorano

a progetti di IA di essere consapevoli che potrebbero

trovarsi di fronte a questo tema, e che tale

tema si affaccia anche per le forme di agency,

ovvero per le capacità delle macchine di pianificare

e gestire azioni con obiettivi che riguardano

sé stesse o gli altri. Ne segue che queste società

dovrebbero realizzare dei piani per considerare

le macchine intelligenti come agenti con valori

morali, da trattare in modo conseguente. Naturalmente

resta aperto il problema di fondo: e se

facessimo di più per gli altri esseri umani?

I diritti delle macchine

Non sappiamo se una macchina potrà mai diventare cosciente né come riconoscerlo,

ma dobbiamo prepararci alleventualità e decidere come ci comporteremo nel caso

Robot industriale

Eugenio Caruso - 14 aprile 2025

Il fiore di girasole, logo del sito, unisce natura, matematica e filosofia.

Tratto da le scienze